CRAWL BUDGET YÖNETİMİNİ PLANLAMAK VE İZLEMEK

Arama motorları sitenizi sınırsızca taramaz; her site için zaman ve kaynak ayırır. Bu sınırlı kaynak, bazı sayfaların hızlı keşfedilip indekslenmesini sağlarken, bazı sayfaların günlerce hatta haftalarca geride kalmasına neden olabilir. İşte tam burada crawl budget devreye girer.

Özellikle çok sayfalı web sitelerinde tarama bütçesi yanlış yönetildiğinde botlar “önemsiz” URL’lerde oyalanır, kritik sayfalar geç taranır ve yeni içerikler arama sonuçlarına geç yansır. Bu durum çoğu zaman içerik eklemekle çözülmez; planlama ve izleme gerektirir.

Bu yazıda, crawl budget yönetimini planlamak ve izlemek için uygulanabilir bir çerçeve sunacağız: tarama sinyallerini okumak, gereksiz URL üretimini azaltmak, log verisiyle doğrulamak ve süreklilik kazandırmak.

Crawl budget kavramını netleştirip etkisini anlamak

Crawl budget, botların sitenizde belirli bir zaman aralığında tarayacağı URL sayısı olarak özetlenebilir. Bu bütçe iki ana başlıkta şekillenir: “crawl rate limit” (botun siteyi yormadan tarama hızı) ve “crawl demand” (botun hangi sayfaları taramak istediği). İkisini birlikte düşünmeden doğru karar vermek zordur.

Crawl demand sinyallerini doğru okumak

Botlar genellikle değerli ve sık güncellenen sayfalara daha fazla ilgi gösterir. Güçlü iç link alan, organik trafik alan, güncellenen ve doğru canonical sinyali veren sayfalar daha sık taranır. Bu yüzden içerik hiyerarşisi ve iç link akışı tarama talebini doğrudan etkiler.

Crawl rate limit sorunlarını erken fark etmek

Sunucu yanıt süreleri yükseldiğinde veya 5xx hataları arttığında botlar tarama hızını düşürür. Bu durum tarama bütçesini küçültür ve tarama sıklığını azaltır. Checklist gibi düşünün: hız regresyonu, yoğun yönlendirme, hatalı cache ayarları tarama hızını geriletir.

Tarama bütçesini boşa harcayan URL’leri azaltmak

Tarama bütçesini tüketen en büyük kalem, “indekslenmesi gerekmeyen” URL’lerin çoğalmasıdır. Parametreler, filtre kombinasyonları, arama sonuç sayfaları, kopya sayfalar ve zayıf sayfalar botların zamanını çalar. Burada hedef, botların “iyi” URL’lere ulaşmasını kolaylaştırmaktır.

Parametreli URL üretimini yönetmek

UTM, sıralama, filtre ve takip parametreleri kontrolsüz büyüdüğünde binlerce benzersiz URL oluşur. Bu URL’ler canonical ile doğru hedefe yönlendirilmezse botlar aynı içeriği tekrar tekrar tarar. Parametre stratejisi; canonical, robots, yönlendirme ve site içi linkleme birlikte ele alınmalıdır.

Thin content sayfalarını tespit edip birleştirmek

Çok az içerikli sayfalar (thin content) hem kalite sinyalini zayıflatır hem de tarama bütçesini tüketir. Bu sayfaları birleştirmek, kategori yapısını güçlendirmek veya noindex ile yönetmek faydalı olabilir. Amaç; “değer üretmeyen” URL’leri azaltmaktır.

- Arama sonuç sayfalarını indeks dışında tutmak

- Filtre kombinasyonlarını sınırlandırmak ve kanonikleştirmek

- Yinelenen sayfaları canonical ile toparlamak

- Otomatik üretilen zayıf etiket sayfalarını azaltmak

Site mimarisini düzenleyip botların yolunu açmak

Tarama bütçesi sadece URL sayısıyla ilgili değildir; botun site içinde “nerelere gidebildiği” ile de ilgilidir. Mimari karmaşıklaştıkça keşif yavaşlar. Burada amaç, kritik şablonlara giden yolu kısaltmaktır.

İç link akışını güçlendirip öncelik vermek

Önemli sayfalar daha fazla iç link aldığında botlar bu sayfaları daha sık ziyaret eder. Menü, breadcrumb, ilgili içerik blokları ve kontekst linkleri burada etkilidir. Ayrıca linklerin anchor metni de konu sinyali taşır; rastgele “tıkla” yerine anlamlı ifadeler tercih edilmelidir.

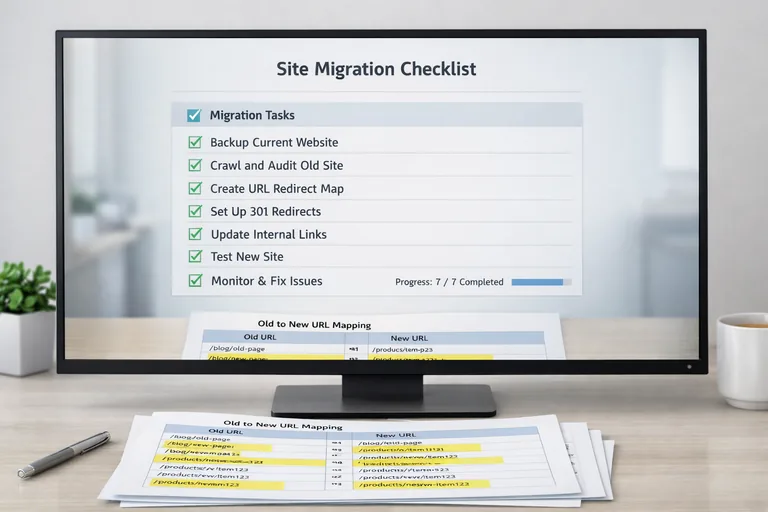

Yönlendirme zincirlerini kısaltıp taramayı hızlandırmak

3xx yönlendirmeler kaçınılmaz olabilir; fakat zincir ve döngüler botların zamanını boşa harcar. Hedef; eski URL’nin tek bir 301 ile nihai URL’ye gitmesidir. Ayrıca 302’nin kalıcı yer değiştirmelerde kullanılması belirsizlik yaratır.

# Nginx örnek: tek adım 301 yönlendirme

location = /eski-kategori/ {

return 301 /yeni-kategori/;

}

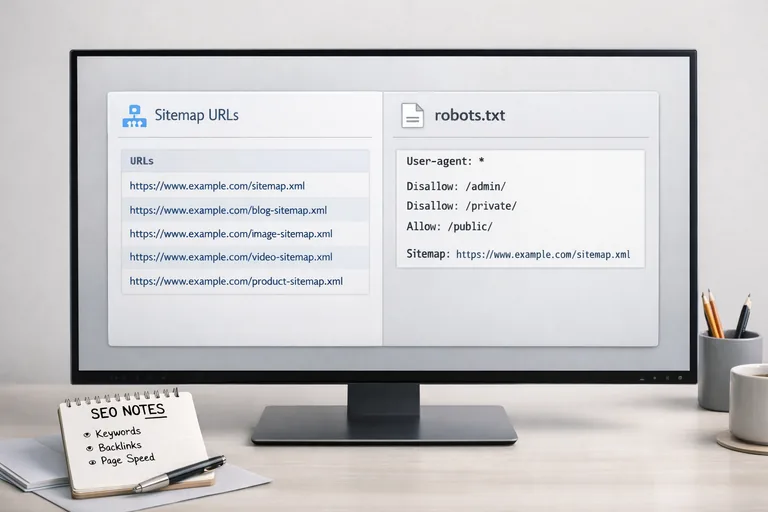

Sitemap ve robots.txt sinyallerini uyumlu kılmak

Botlar için en net niyet sinyallerinden biri sitemap’tir. Sitemap, botlara “şu URL’ler önemli” der. Ancak sitemap ile robots.txt ve canonical sinyalleri çelişirse tarama bütçesi verimsizleşir. Bu bölümde amaç, sinyallerin tutarlılığını sağlamaktır.

Sitemap’i temizleyip sadece hedef URL’leri eklemek

Sitemap içinde 200 dönen, canonical’ı kendine işaret eden ve indekslenmesini istediğiniz URL’ler yer almalıdır. Parametreli URL’ler, yönlenen URL’ler, 404 dönen URL’ler sitemap’e giriyorsa botların zamanı boşa gider. Düzenli sitemap hijyeni, tarama verimliliğini artırır.

robots.txt ile tarama alanını akıllı sınırlamak

robots.txt, taramayı kısıtlar; indeksleme kararını tek başına vermez. Bu yüzden “Disallow” ile kritik sayfaları kazara kapatmak risklidir. En iyi kullanım; arama sonuçları, sepet, hesap sayfaları gibi gereksiz tarama alanlarını kapatmaktır.

# robots.txt örneği: gereksiz alanları kapatıp sitemap tanımlamak

User-agent: *

Disallow: /arama/

Disallow: /sepet/

Disallow: /hesap/

Allow: /

Sitemap: https://example.com/sitemap.xml

Log analiziyle taramayı izlemek ve kararları doğrulamak

Tarama bütçesi konuşulurken en güvenilir veri kaynağı sunucu loglarıdır. Çünkü loglar, botların gerçekten hangi URL’lere geldiğini, hangi durum kodlarını aldığını ve ne sıklıkta ziyaret ettiğini gösterir. Search Console yardımcıdır; ancak loglar daha “ham” ve daha gerçektir.

Bot isteklerini ayıklayıp URL gruplamak

Loglarda önce bot user-agent’larını ve IP doğrulamasını planlayın. Ardından URL’leri şablon bazında gruplayın: ürün, kategori, blog, arama, parametreli sayfalar gibi. Böylece tarama bütçesinin hangi alanlarda harcandığını görürsünüz.

Durum kodu ve yanıt süresini birlikte değerlendirmek

Yüksek 5xx oranı veya yavaş yanıt süreleri, tarama hızını düşürür. Ayrıca 404’ler iç link kırıklarıyla birleştiğinde tarama bütçesini tüketir. Burada hedef; 200 oranını artırmak, zincirleri azaltmak ve sunucu performansını stabilize etmektir.

Bu analizleri ekip içinde standart hale getirmek ve farklı rolleri aynı çerçevede buluşturmak için pratik örneklerle ilerleyen bir SEO eğitimi süreci, karar almayı hızlandırır.

Planı sürdürülebilir kılıp düzenli izlemek

Tarama bütçesi bir kere “düzeltilip” unutulacak bir konu değildir. Yeni sayfalar, yeni filtreler, kampanyalar ve teknik değişiklikler URL üretimini yeniden büyütebilir. Bu yüzden planı rutinlere bağlamak gerekir.

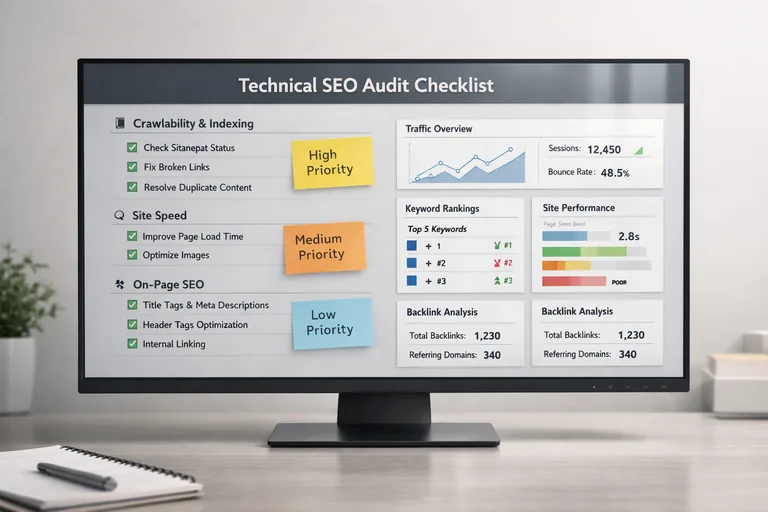

Haftalık izleme metriklerini tanımlamak

Her hafta bakılacak basit bir metrik seti belirleyin: taranan URL sayısı, tarama hataları, 5xx oranı, parametreli URL payı, sitemap’teki geçerli URL sayısı ve önemli şablonların tarama sıklığı. Böylece sapmaları erken yakalarsınız.

Release sonrası kontrol adımı eklemek

Yeni özellik yayınlarında özellikle filtreleme, arama, yönlendirme ve canonical davranışı değişebilir. Release sonrası kısa bir tarama ve log kontrolü, “tarama bütçesi sızıntılarını” büyümeden yakalar. Bu adım küçük görünür ama etkisi büyüktür.

Özetle, crawl budget yönetimini planlamak ve izlemek; gereksiz URL’leri azaltmak, sinyalleri tutarlı hale getirmek ve log verisiyle doğrulamaktır. Doğru uygulandığında botlar sitenizde daha verimli gezinir, kritik sayfalar daha hızlı keşfedilir ve indeksleme daha sağlıklı ilerler.