SİTEMAP VE ROBOTS.TXT KURGUSUNU DOĞRU YAPMAK

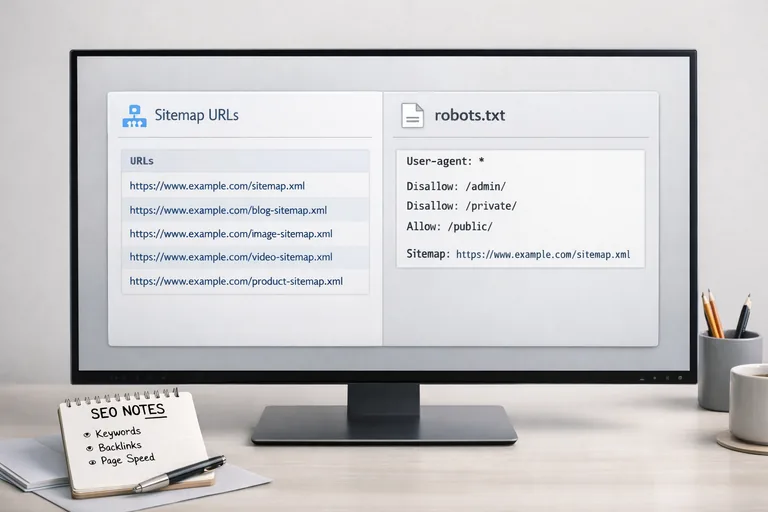

Arama motorlarının sitenizi nasıl taradığı, çoğu zaman içerikten önce “yol tarifine” bağlıdır. Sitemap ve robots.txt bu yol tarifinin iki temel parçasıdır: sitemap “şu URL’ler önemli” der, robots.txt ise “şu alanlara girme” diyebilir. Doğru kurgulandığında keşfi hızlandırır, yanlış kurgulandığında ise görünürlüğü sessizce düşürür.

Özellikle çok sayfalı web sitelerinde, filtreler, parametreler, dahili arama ve yinelenen şablonlar tarama bütçesini boşa harcatır. Bu karmaşayı temizlemek için sitemap ve robots.txt birlikte düşünülmelidir. Sadece robots ile kapatmak veya sadece sitemap’i büyütmek tek başına çözüm değildir; sinyallerin tutarlı çalışması gerekir.

Bu yazıda sitemap ve robots.txt kurgusunu doğru yapmak için pratik bir çerçeve sunacağız: hangi URL’ler sitemap’e girmeli, robots ile hangi alanlar sınırlandırılmalı, yaygın hatalar nasıl yakalanmalı ve yayın sonrası nasıl izlenmelidir.

Sitemap ve robots.txt rolünü netleştirip birlikte kurgulamak

Sitemap, keşfi hızlandıran bir “öncelik listesi” gibi çalışır; robots.txt ise taramayı sınırlayan bir “erişim politikası”dır. İkisi birbiriyle çelişirse arama motoru kararsız kalabilir. Bu yüzden önce rol paylaşımını netleştirip sonra uygulamaya geçmek gerekir.

Sitemap’in keşif sinyali üretmesini sağlamak

Sitemap, indekslenmesini istediğiniz URL’leri düzenli biçimde sunar. Bu, yeni sayfaların daha hızlı keşfedilmesini ve kritik sayfaların tarama sıklığının artmasını destekleyebilir. Ancak sitemap şişerse, “önemli” sinyali zayıflar ve botlar gereksiz URL’lere harcanabilir.

robots.txt’nin tarama alanını sınırlamasını planlamak

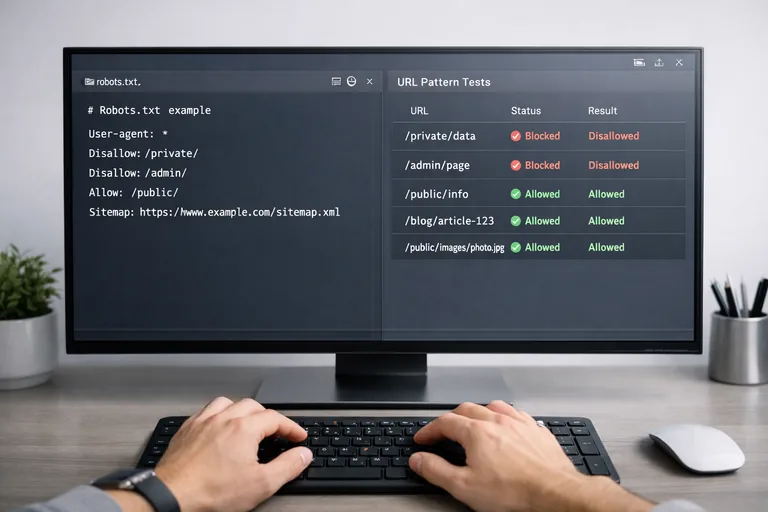

robots.txt, botlara belirli dizin ve URL desenlerini taramamasını söyleyebilir. Ancak robots, indekslemeyi tek başına “kesin” kapatmaz; sadece taramayı engeller. Bu yüzden robots, noindex ve canonical gibi sinyallerle karıştırılmamalıdır.

Sitemap kapsamını belirleyip kaliteyi artırmak

Sitemap’in temel amacı “indekslenmesi gereken hedef URL’leri” sunmaktır. Bir sitemap dosyasında yönlenen URL’ler, 404 dönen URL’ler veya canonical’ı başka sayfaya giden URL’ler varsa, hem keşif verimsizleşir hem de sinyal tutarlılığı bozulur.

Hedef URL kriterlerini standartlaştırmak

Genel kural: sitemap’e giren URL 200 dönmeli, canonical’ı kendisini göstermeli ve gerçekten indekslenmesini istemelisiniz. Ayrıca parametreli URL’ler ve dahili arama sayfaları sitemap’e girmemelidir. Bu kriterler, sitemap’i “temiz” tutar.

Sitemap’i şablonlara bölüp yönetimi kolaylaştırmak

Çok sayfalı sitelerde tek bir büyük sitemap yerine şablon bazlı sitemap’ler (ürün, kategori, blog gibi) üretmek daha yönetilebilir olur. Böylece sorun çıktığında hangi sitemap’in bozulduğunu hızla bulursunuz. Ayrıca sitemap index yapısıyla dosyaları topluca sunabilirsiniz.

<!-- sitemap index örneği -->

<sitemapindex xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<sitemap>

<loc>https://example.com/sitemaps/sitemap-urun.xml</loc>

</sitemap>

<sitemap>

<loc>https://example.com/sitemaps/sitemap-blog.xml</loc>

</sitemap>

</sitemapindex>

robots.txt ile gereksiz taramayı azaltmak

robots.txt, tarama bütçesini boşa harcatan alanları sınırlandırmak için güçlü bir araçtır. Burada amaç, botların zamanını değer üretmeyen URL’lerde harcamasını engelleyip önemli şablonlara daha fazla kaynak ayırmasını sağlamaktır.

Dahili arama ve filtre sayfalarını sınırlandırmak

Dahili arama sonuçları ve bazı filtre kombinasyonları genellikle indeks için gerekli değildir. Bu sayfalar tarandığında hem tarama bütçesi tüketir hem de kopya URL riskini büyütür. robots ile doğru desenleri kapatmak, bot davranışını daha verimli hale getirir.

Statik dosyaları yanlışlıkla engellememek

CSS ve JS dosyalarını engellemek, sayfanın render edilmesini zorlaştırabilir ve kalite değerlendirmesini olumsuz etkileyebilir. robots.txt yazarken “neye izin veriyorum, neyi kapatıyorum” dengesini korumak gerekir. Geniş kapsamlı Disallow satırları bu yüzden dikkat ister.

# robots.txt örneği: gereksiz alanları kapatıp sitemap belirtmek

User-agent: *

Disallow: /arama/

Disallow: /sepet/

Disallow: /hesap/

Disallow: /*?utm_

Disallow: /*?sort=

Allow: /

Sitemap: https://example.com/sitemap.xml

Yaygın hataları önleyip sinyal çakışmasını engellemek

Sitemap ve robots.txt yanlış uygulandığında sorunlar genellikle sessiz ilerler: sayfalar daha geç keşfedilir, yeni içerikler yavaş indekslenir veya önemli URL’ler görünmez olur. Bu nedenle yaygın hataları bilip kontrol listesiyle ilerlemek gerekir.

Sitemap’te yönlenen ve hatalı URL’leri temizlemek

301/302 ile yönlenen URL’ler sitemap’te kaldığında botlar önce eski URL’ye gider, sonra yönlendirmeyi takip eder. Bu hem verimsizdir hem de “eski URL hâlâ önemli” sinyali üretir. 404 dönen veya 5xx alan URL’ler de sitemap’ten çıkarılmalıdır.

robots ile kapatıp sitemap’te listelememek

Bir URL’yi robots ile kapatıp aynı URL’yi sitemap’te listelemek çelişkidir. Bu durumda botlar sitemap’ten URL’yi görür ama robots nedeniyle tarayamaz; sonuçta sinyal boşa gider. Hangi URL’lerin indekslenmesi hedefleniyorsa, sitemap ve robots birlikte uyumlu olmalıdır.

- Sitemap’te sadece 200 dönen hedef URL’leri tutmak

- Parametreli URL’leri sitemap’ten dışarıda bırakmak

- robots ile kapatılan alanları sitemap’e sokmamak

- CSS/JS gibi kritik kaynakları yanlışlıkla engellememek

Doğrulama ve izleme rutinini kurup süreklilik sağlamak

Doğru kurgu, düzenli izleme ile kalıcı hale gelir. Tema güncellemeleri, filtre özellikleri, kampanya parametreleri ve yeni şablonlar sitemap/robots dengesini bozabilir. Bu yüzden basit ama düzenli bir kontrol rutini oluşturmak gerekir.

Örnek URL setiyle periyodik kontrol yapmak

Her şablondan örnek URL seçip şu kontrolleri yapın: URL sitemap’te var mı, 200 dönüyor mu, canonical kendisini gösteriyor mu, robots tarafından engelleniyor mu? Bu test, küçük bir bozulmayı erken yakalamanızı sağlar.

Tarama ve indeksleme raporlarını takip etmek

Search Console’da sitemap işlenme durumu, indeks kapsama sorunları ve tarama hataları düzenli izlenmelidir. Ani artışlar genellikle yeni bir şablonun sitemap’e yanlış girmesi veya robots kurallarının yanlış genişlemesi gibi değişikliklere işaret eder.

Bu kurguyu ekip içinde standart hale getirip yayın süreçlerine kontrol adımı eklemek için uygulamalı bir SEO eğitimi, teknik ve içerik ekiplerinin aynı kontrol listesiyle ilerlemesini kolaylaştırır.

Özetle, sitemap ve robots.txt kurgusunu doğru yapmak; hedef URL’leri temiz bir sitemap’te toplamak, gereksiz tarama alanlarını robots ile sınırlamak, sinyal çakışmalarını önlemek ve düzenli doğrulama ile süreklilik kazandırmaktır. Bu disiplin, tarama bütçesini verimli kullanmayı ve önemli sayfaların daha hızlı keşfedilmesini destekler.